向量数据库选型指南:在极致性能与运维代价间游走

如今业界涌现了数十种向量数据库,但本指南并非一份单纯的“QPS 跑分排行榜”。相反,我们将基于 “真实工程落地代价” 与 “系统架构复杂度” 的双重视角来为您梳理。

读者将在这里感受到一种真实的“工程冷水”:在各种 Demo 中大放异彩的专用向量数据库,在那些追求 99.9% SLA、时刻关注数据一致性与运维成本的一线工程师眼中,往往意味着沉重的基础设施负担。真正的工业级 RAG(检索增强生成)系统架构,正在从“盲目引入新组件”回归“务实”:如果能用现有的 PostgreSQL 解决问题,就绝不轻易引入新的分布式集群。理解这种从“跑分狂欢”到“架构妥协”的落差,正是构建稳健 AI 应用的必经之路。

前言

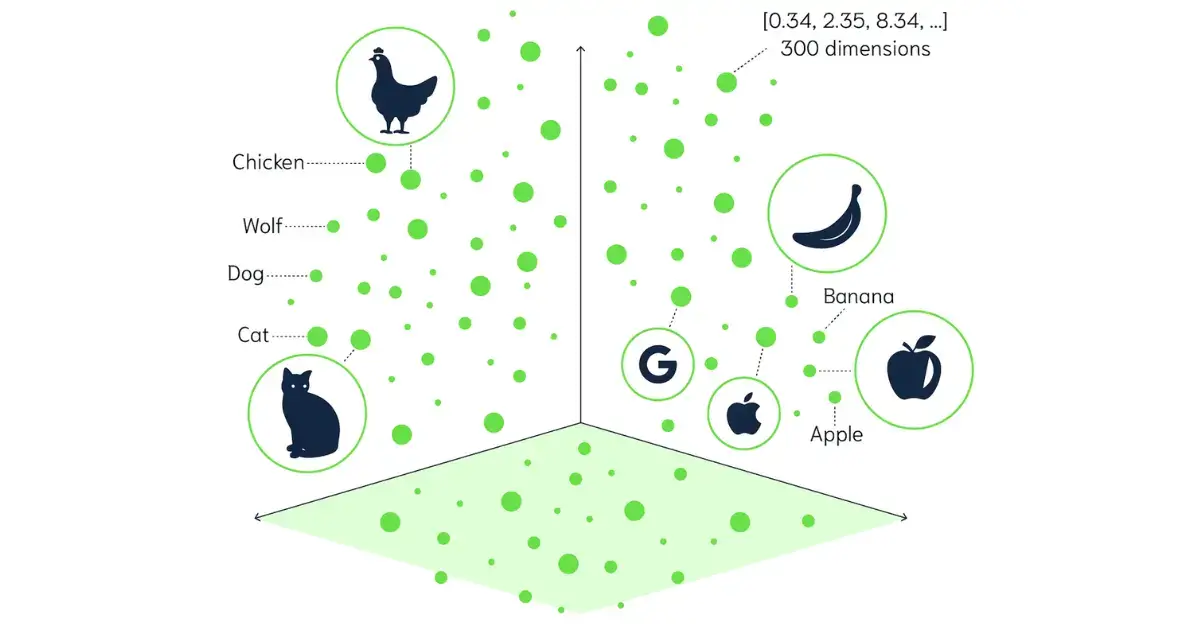

在构建基于大语言模型(LLM)的应用,尤其是检索增强生成(RAG)系统时,向量数据库(Vector Database) 似乎已经成为不可或缺的“标配”。它们专为高效存储、索引和查询高维向量嵌入(Embeddings)而生。

然而,与大语言模型从 GPT-1 到 Multi-Agent 那条脉络清晰的演进史不同,向量数据库并没有一条绝对线性的“技术进化路线”。当下的生态中,各种架构流派并行繁荣——从底层的 C++ 搜索库,到重型的分布式集群,再到传统关系型数据库的插件化觉醒。

站在一线 AI 工程(AI Engineering)和后端架构的视角,引入一个全新的数据库组件绝非易事。它意味着你必须直面令人头疼的“双写一致性”、灾备恢复、监控报警以及复杂的权限管控。因此,本文旨在以 “架构流派与工程取舍(Trade-off)” 为切入点,重新梳理当前主流的向量搜索工具。我们将带您一探究竟:AI 工程师们是如何在不同的业务场景下,在性能上限与运维代价之间精妙地“走钢丝”的。

架构流派一:纯粹的算法引擎 (The Algorithmic Engines)

解决“如何在内存中极速找到最相似向量”的纯粹计算问题,彻底抛却数据库管理的负担。

1. FAISS: 暴力的性能巨兽

开发商: Meta (Facebook AI Research)

在专用向量数据库迎来大爆发之前,FAISS (Facebook AI Similarity Search) 几乎是唯一的工业标准。它底层由 C++ 编写,提供了极其丰富的索引类型(从简单的 Flat 暴力搜索,到 IVF、HNSW,再到极度压缩内存的 PQ 乘积量化)。

工程视角下的 Trade-off: 时至今日,FAISS 的搜索性能和对 GPU 的压榨能力依然处于顶级水平。但在高级 AIE 眼中,它仅仅是一个“算法引擎”,绝不能等同于数据库。 为什么?因为它没有 CRUD(增删改查)接口,不支持网络协议,一旦进程崩溃,内存中的索引若未手动落盘便会灰飞烟灭。在现代微服务架构中,如果直接在应用代码里揉捏 FAISS 索引状态,往往会酿成内存泄漏和并发冲突的灾难。因此,它现在更多地是被封装在高级数据库的底层,或者专用于离线的海量数据批处理聚类。

2. ANNOY: 极简的静态映射

开发商: Spotify

ANNOY (Approximate Nearest Neighbors Oh Yeah) 基于随机投影树算法。它的核心设计哲学非常明确:生成一个极小的只读索引文件,随后通过 mmap(内存映射)技术让多个进程轻松共享。

工程视角下的 Trade-off: ANNOY 简直是为推荐系统这类“离线计算、在线读取”的场景量身定制的。但它的致命伤同样显而易见:“不可变性”。 它不支持动态插入或更新,任何新数据的加入都意味着必须重新构建整棵树。对于知识库可能随时更新的 RAG 场景来说,ANNOY 显得过于僵化。不过,得益于其出色的内存友好特性,它在特定的静态检索场景中依然稳占一席之地。

架构流派二:云原生与分布式巨兽 (The Distributed Heavyweights)

应对百亿级向量数据的持久化,实现分布式横向扩展与极高并发访问。

1. Milvus: 企业的重型装甲

作为最早开源的云原生向量数据库之一,Milvus 走的是绝对的“大厂路线”,天生专为处理百亿级甚至千亿级向量数据而设计。

工程视角下的 Trade-off: Milvus 的架构极其庞大且解耦彻底(接入层、协调层、执行层和存储层完全分离)。但在 MLE 看来,标准的 Milvus 是一台名副其实的“运维巨兽”。 要部署一个高可用的集群,你通常得配套拉起 MinIO(对象存储)、etcd(元数据管理)以及 Pulsar/Kafka(消息队列)。虽然它能提供无与伦比的吞吐量,但倘若你的数据量远未达到千万甚至亿级别,引入这套重型装甲所带来的运维成本无疑是“杀鸡用牛刀”,往往得不偿失。

2. Qdrant: 性能与过滤的平衡大师

Qdrant 是一款完全由 Rust 编写的开源向量数据库。其架构设计极为现代,不仅资源占用低,还原生支持分布式集群部署。

工程视角下的 Trade-off: Qdrant 最直击工程师痛点的,是其 强大的 Payload Filtering(元数据过滤)能力。在真实的 RAG 业务中,孤立的纯向量检索十分罕见,往往都伴随着复杂的业务条件(例如“寻找与 X 最相似的文档,且该文档的作者是 Y”)。Qdrant 在构建 HNSW 索引时就深度融合了这些过滤条件,巧妙避开了“先向量检索再后置过滤导致结果集为空”的尴尬境地。对于需要高性能并发、且业务逻辑重度依赖复杂条件过滤的生产级应用而言,Qdrant 堪称极佳的选择。

3. Weaviate: AI 原生的模块化拼图

Weaviate 明确将其定位为“AI Native”的分布式向量搜索引擎。它采用 Go 语言编写,不仅扩展性强悍,易用性也备受赞誉。

工程视角下的 Trade-off: 如果说 Milvus 像一台底盘沉稳的重卡,那么 Weaviate 更像是一套高度灵活的乐高积木。其最大的工程卖点在于“内置的 AI 模块化能力(Modules)”。你可以直接在数据库端配置 OpenAI 或 Hugging Face 的 API Key,Weaviate 会在写入时自动将文本转换为向量,并在查询时自动对用户的自然语言进行 Embedding 计算。对于前端和业务后端开发者来说,这直接省去了维护 Embedding 生成管道的大量“脏活累活”。此外,它还天然支持优雅的 GraphQL 接口以及“文本+向量”的混合搜索。

4. Vespa: 搜索与排序的工业级航母

Vespa 源自 Yahoo,是一个久经考验的大数据服务和排名引擎(Big Data Serving Engine),并在后续发展中原生集成了先进的向量索引。

工程视角下的 Trade-off: 把 Vespa 仅仅称作“向量数据库”实在有些委屈它了。它真正的威力在于:支持在数据节点上直接运行复杂的机器学习模型(包括 TensorFlow、ONNX 乃至自定义张量计算),从而进行深度的重排(Re-ranking)。 面对电商商品推荐、大型信息流分发等极端复杂的场景,我们往往需要“召回 -> 粗排 -> 精排”的多阶段流水线。Vespa 能够在极低的延迟内,端到端地完成这套复杂的排序逻辑。但这背后也暗藏着高昂的代价:极高的学习门槛、复杂的 Java/C++ 底层架构,以及只有顶尖数据工程团队才能驾驭的运维难度。

架构流派三:敏捷验证与全托管服务 (The Agile & Serverless)

助力团队从 0 到 1 快速跑通业务逻辑,并将基础设施的运维负担降至零。

1. Chroma: AI 原生时代的敏捷先锋

Chroma(ChromaDB)几乎是伴随着 LangChain 和 LlamaIndex 的爆火而崛起的。它的定位极其清晰:为 LLM 应用开发者提供最丝滑的本地开发体验。

工程视角下的 Trade-off: Chroma 的 API 设计将优雅发挥到了极致,不仅开箱即用,甚至可以作为内存进程或本地 SQLite 文件运行。但若从严肃后端的视角来审视,它更像是一个用来快速验证想法的“原型(Prototyping)工具”。 在处理超大规模数据分布、复杂的访问控制(RBAC)以及应对极致的稳定性要求时,Chroma 并不占优。因此,它非常适合个人开发者、Hackathon 比赛项目,或是企业内部轻量级知识库的概念验证。

2. Pinecone: 资本与 Serverless 的极致

作为完全闭源的托管式(Serverless)云端向量数据库,Pinecone 为开发者提供了真正意义上的“免运维”体验。

工程视角下的 Trade-off: 对于那些不想碰任何基础设施(如 K8s、存储挂载等)、预算充足且急需明天就上线的商业项目来说,Pinecone 是完美之选。API 调用即服务,扩容也只需在控制台点按按钮。然而,这种安逸背后的代价是高昂的使用成本以及极强的“厂商锁定(Vendor Lock-in)”。 工程师必须审慎权衡:省下的运维人力成本,是否足以覆盖其按流量和存储量持续计费的长期账单。

架构流派四:传统基础设施的实用主义觉醒 (The Pragmatic Extensions)

有效遏制系统架构复杂度的膨胀,在团队早已熟稔的现有基础设施上自然地“长”出 AI 能力。

1. pgvector (PostgreSQL): 架构师的最终归宿

当开源关系型数据库的无冕之王 PostgreSQL 迎来了 pgvector 扩展,整个向量数据库市场的格局被彻底改写。

工程视角下的 Trade-off: 在资深架构师的字典里,“最好的新数据库组件,就是没有新组件”。引入专门的向量数据库通常会引发著名的“双写一致性”灾难:比如当你在 MySQL 中删除一个用户时,必须确保在 Milvus 中同步删除了他的向量数据。而 pgvector 完美化解了这一难题:向量,不过是表中的一个普通字段罢了。你可以使用熟悉的 SQL 进行强一致性的 ACID 事务操作,甚至与几十张关系表进行极度复杂的 JOIN 查询。虽说其极限检索 QPS 也许拼不过纯粹的 Qdrant,但对于 90% 数据量在千万级以下的企业级应用来说,pgvector 的性能已经绰绰有余,且带来的架构成本几乎为零。

2. Elasticsearch / OpenSearch: 混合搜索的无冕之王

作为老牌的全文搜索引擎,ES 和 OpenSearch 审时度势地引入了对 dense_vector 的原生支持。

工程视角下的 Trade-off: 纯粹的语义向量搜索一直有个致命弱点:对专有名词、产品型号或是缩写(如“iPhone 15 Pro Max 256G”)极度不敏感。而 ES 的杀手锏恰恰在于,它能将业界最顶级的 BM25 文本关键词检索与向量检索完美融合,实现真正意义上的混合搜索(Hybrid Search)。 如果你的系统本来就已经在使用 ES 处理日志或文档检索,那么直接复用它来充当 RAG 的召回层无疑是最稳妥的策略。当然,你需要承受的代价是 ES 出了名的庞大 JVM 内存占用。

3. ClickHouse: OLAP 引擎的降维打击

作为以极致查询性能傲视群雄的列式分析型数据库 (OLAP),ClickHouse 在近期的版本中也加入了原生的向量检索能力战局(支持精确搜索与 HNSW 等近似搜索,并引入了前沿的 QBit 二值量化技术)。

工程视角下的 Trade-off: ClickHouse 最令人拍案叫绝的,是其处理 海量数据结构化与非结构化混合搜索 的卓越能力。当面临类似于“在 10 亿条电商数据中,寻找与特定图片最相似的商品,同时要求销量 > 1000 且品牌为 X”这样的极端需求时,传统的向量数据库往往会在复杂的过滤环节陷入性能瓶颈。而 ClickHouse 能够充分利用其底层的 SIMD 向量化执行引擎和跳数索引(Skipping Index),在进行向量检索的同时极速完成复杂的条件过滤与数据聚合(如 SUM, AVG)。它的局限在于不适合高频的行级数据更新,且对于简单的小型 RAG 系统来说部署显得过于笨重;但如果你的团队本就已经在使用 ClickHouse 进行日志分析或大数据 BI,复用它来兼做大规模向量检索,绝对是一场降维打击。

4. MongoDB, MySQL 与 Oracle: 拥抱 AI 时代

MongoDB Atlas 提供了内置的向量搜索,MySQL 8.4+ 和 Oracle 23ai 最终也加入了原生向量数据类型支持的阵营。

工程视角下的 Trade-off: 这些特性的加入,主要是为了拯救那些背负着特定技术栈包袱、且面临金融级严格合规要求的大型企业。它们允许企业在完全不改变现有网络拓扑结构的前提下,推动核心业务系统平滑转型。尽管其目前的向量生态和索引优化相比 pgvector 等先发者还在奋力追赶,但其背后坚不可摧的 ACID 保障以及与 SQL 优化器的深度集成,是任何新兴数据库在短时间内都难以企及的壁垒。

架构流派五:极速缓存与端侧利刃 (The Speed & Edge Blades)

征服“亚毫秒级低延迟响应”与“端侧设备本地脱机运行”的极端场景挑战。

1. Redis (RediSearch): 缓存层的亚毫秒狂飙

基于内存的键值对数据库霸主 Redis,通过模块扩展的方式强势引入了向量搜索能力。

工程视角下的 Trade-off: Redis 的核心标签永远是“极速”。在 AI 应用落地的过程中,它最典型的工程角色并非海量知识库的主存储,而是充当 LLM 语义缓存(Semantic Cache)。当你发现大量用户在反复询问相似的问题时,通过 Redis 的向量检索瞬间命中缓存答案,不仅能把响应延迟极度压缩到亚毫秒级,更能为你省下惊人的 LLM API 账单。这是用高昂内存成本换取极致响应时间与经济效益的经典架构策略。

2. sqlite-vec: 端侧计算的微型利器

作为 sqlite-vss 的继任者,sqlite-vec 是一款完全使用 C 语言编写、零外部依赖的极速轻量级扩展。

工程视角下的 Trade-off:

随着 Agentic AI 向端侧(手机、PC 本地)转移的洪流(例如小语言模型 SLM 的爆发),我们显然不可能在用户的个人设备上部署一个庞大的 PostgreSQL 集群。与 SQLite 完美结合的 sqlite-vec,提供了一个体积仅数百 KB、却能在本地进行极速向量检索的微型数据库。它无疑是构建本地桌面 AI 应用、浏览器插件或边缘计算设备的完美利刃。

3. LanceDB: 降本增效的 Serverless 奇兵

LanceDB 构建在 Lance 格式(一种专为多模态 AI 设计的现代列式存储格式,堪称 Arrow/Parquet 的进化版)之上,是一款备受瞩目的开源 Serverless 向量数据库。

工程视角下的 Trade-off: 当前绝大多数的高性能向量检索(如 HNSW 算法)都极度依赖昂贵的 RAM(内存)。而 LanceDB 最大的工程颠覆正是在于:它在廉价的磁盘(SSD)上,实现了无限逼近内存级别的向量检索速度。它可以像 SQLite 一样作为嵌入式库直接集成到 Python 或 Node.js 进程中,并将海量的向量数据持久化在对象存储(如 AWS S3)上,真正实现“Scale to Zero(缩容到零)”。如果你需要处理海量的多模态数据(图像、视频音频帧)又对高昂的内存账单望而却步,LanceDB 所提供的“基于磁盘的存算分离”架构,绝对是当下最佳的降本增效奇兵。

结语

当我们再次审视目前百花齐放的向量数据库生态时,会清晰地发现:关于“究竟该选择哪个工具”的答案,从来都不在于谁的 Benchmark 跑分最亮眼,而在于你身处怎样的工程约束与业务困境之中。

作为 AI 工程师,我们的崇高使命早已不再是盲目追逐基准测试上的极限性能,而是要根据业务的真实数据规模、现有技术栈的历史沿革以及团队的实际运维能力,在纯算法引擎、分布式巨兽、敏捷 SaaS 服务和传统数据库扩展之间,做出最务实、最睿智的架构妥协。

请永远记住:底层的基础模型决定了 RAG 系统回答质量的绝对上限;但你所选择的数据库架构与检索策略,才真正决定了这个系统能否在残酷的生产环境中,稳定地活过明天。